欢迎来到「C位」,它是CMC资本团队全新打造的与创业圈、科技产业、学术界分享交流的频道。通过这个窗口,我们关注和记录在当下发生的诸如企业数字化、产业智能化、业务自动化、无人驾驶与智能车、新能源技术、元宇宙等一系列科技领域中的技术前沿、创业实践,以及行业趋势思考,内容形式包括业界对话、行业观察、投资观点等等。我们期望以开放的信息分享和坦诚的观点解构为特色,注重质量,持续输出。

近日,CMC资本孵化企业上海数字大脑研究院第一期技术沙龙开幕,沙龙邀请到UCL计算机系教授、上海数字大脑研究院联合创始人兼院长汪军教授与大家分享《机器意识:人工智能终极问题“最后一公里”》这一话题,为大家讲述当今深度学习的困境及如何把神经学习和AI融合,以机器意识破局。本期「C位」刊载汪军教授在沙龙上分享内容的完整视频和对应的文字信息。

汪军 Jun Wang

上海数字大脑研究院联合创始人兼院长

UCL(伦敦大学学院)计算机系教授

哔哩哔哩

,,,

数字大脑技术沙龙第一期——院长汪军谈机器意识

以下是讲座的完整实录:

1

当今AI深度学习的困境

以深度学习为代表的人工智能现今已走到了一个困境,出现很多问题,较难用现有方式解决,它需要一个大突破,让它从量变走向质变。

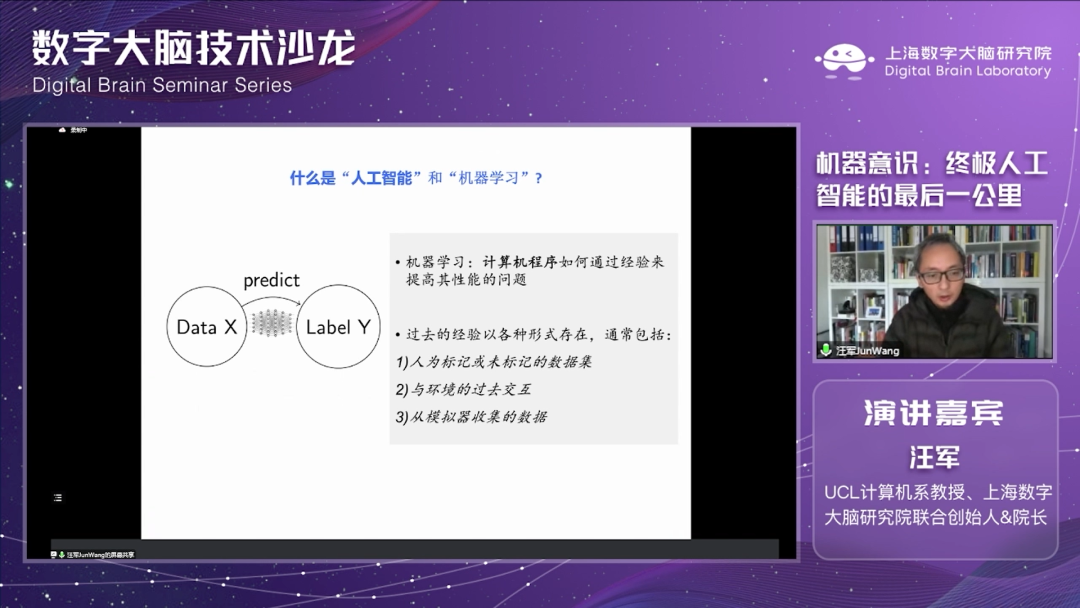

首先,要解决困境,需弄清机器学习是什么?机器学习,是让计算机程序通过经验提高机器性能。机器学习一个常用手段是通过神经网络实现把给定的X数据信息,映射到标签Y上。举个例子,如人脸识别,通过对特定图像的学习,给人脸图像打上标签,神经网络便可做出映射。通过这种学习方式,积累大量的XY映射数据,让AI达到精确的映射结果。不同的机器学习方式,会有不同的映射方式。比如,我们一般讲的“模式识别”,是识别数据里的模式(Pattern),同时也可以攻克决策问题——AI不仅可预测,还可基于观察和优化环境输出决策(Action)。举个典型的例子,如自动驾驶,AI不仅需识别路况,同时还要控制车辆在整个环境中行驶。还有一个典型的例子是多智体,在智能驾驶的场景里,不仅有十字路口的环境,还有对方的车,自己的车,这时就需两个车同时进行决策。两车在考虑到对方决策的互相影响情况下,应该如何互动?这就是多智体人工智能。在人工智能走向成熟的过程中,将会有越来越多的交互,包括人机交互,机器与环境的交互。

万变不离其宗,在上述的场景里,用神经网络(Neural Network)都能解决一定的问题。比如模式识别里,用数据映射到标签,强化学习后,所有的映射关系都可以用神经网络来描述。那神经网络到底是什么呢?追本溯源,它是基于对人类大脑和脑细胞的研究,用计算机模拟成的人工神经网络(Artificial Neural Network)。这个神经网络接收其他神经元的刺激,并把它结合在一起做出决策。在神经网络的大网里包括各种参数,通过调参数来调节神经网络的运作模式。

那深度学习(deep learning)是什么呢?它的本质就是神经网络,只是在此基础上一层层叠加起来。它的目的是逐步学习表征隐藏层。隐藏层是从输入到输出之间所有其他的层。有些数据可能非常大,可能有噪声,而深度学习起的是逐层表征的作用。工程人员和科研人怎样把映射XY运用在各种场景,取决于怎么定义X和Y。有数据时,可以进行监督学习;没有数据时,可以做正负样本来完成异常检测;还可以做强化学习,Y是决策,X是状态,进行回归。

深度学习给我们提供了非常好的方案,但它能否让我们最终解决所谓的人工智能问题,使智能达到极致?或者说,让人工智能的水平达到和人的认知水平一样,甚至更好?答案是否定的。从学习的角度去看,机器学习里有所谓的“天下没有免费的午餐”(no free lunch),针对特定学习方法,给予机器数据学习后,结果总是在某些数据上,效果好,但总会有一些映射关系效果差。这就是没有免费的午餐,因为难以找到一个通用的机器学习公式,适用于任何问题和任何人。因为本质上任何深度学习的算法里它都有先验的知识,这些先验知识是对某一特定问题属性的了解,在一开始,先验知识必须要放到学习里,机器才可以学习起来。所以即使人工智能足够聪明,但它总是在某些任务上表现好,在某些表现差,所以对于AI,我们不可能期待它具有普适性。

在这种情况下,问题来了,作为AI,应该去适应任何环境的变化并作出决策。而在无免费午餐的条件下它必然有适应不了的环境。在这种悖论下,我们该怎么理解?用怎样的方法来破现有的深度学习?关键是适应性(adaptation)深度学习,即适应任何已告知的环境,但当一些未告知的情况出现,它可能就会出错。

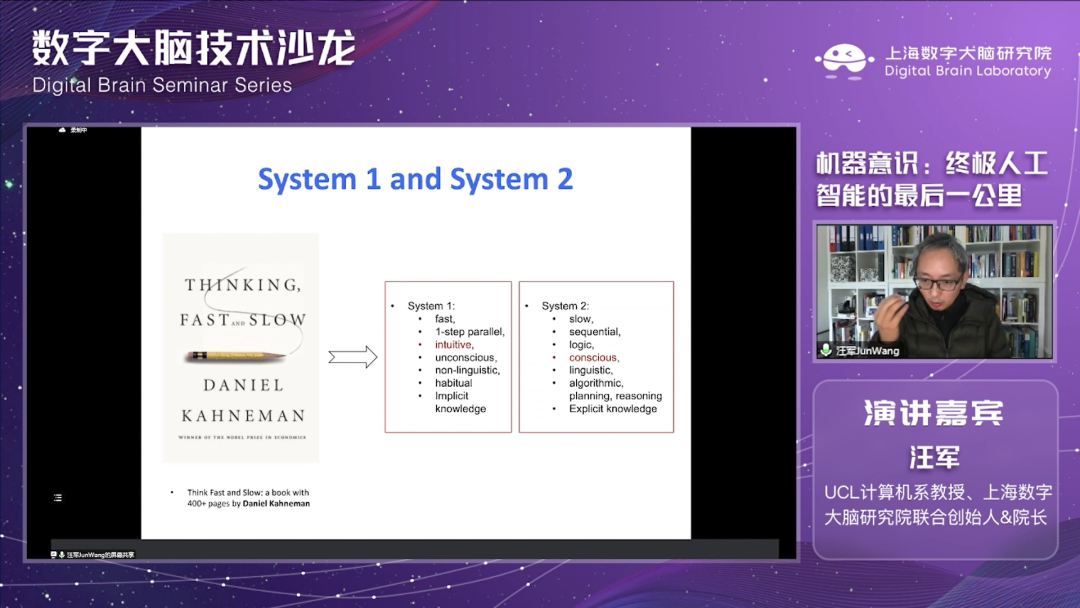

回到人处理环境瞬时变化时,需要适应当前环境再做决定的,这时候要把注意力放到意识上,才能把事情完成。所以人进行决策判断的时候有两种系统,系统1和系统2。一些神经科学家认为我们应该从系统1移到系统2。那么系统1是非意识层面的,系统2是需要意识做复杂判断的。我们再稍做分析,还有比较低级的智能体或者说任何动物都有的,比如条件反射,它是一个应激性反应。大家都知道巴甫洛夫的条件反射实验,这是动物最基本的对环境适应的本能,但这是低级的,不需要意识。我们也看到另外一个叫"主观能动性",有意识地做一些决策。但是在神经科学里,如何理解人类的认知以及意识在其中扮演的角色和作用是仍然没解决的问题。

2

破局之道:神经科学与意识的融合

神经科学(Neuroscience)做了很多human subject study,观察当人有意识的时候,或者 system two 控制的时候,大脑哪个地方激活了。他们发现当有意识去控制的时候,大脑所有的地方都被激活了。而在没有意识或系统1控制的时候,大脑只有一部分激活。这说明它有两套不同的系统。在做复杂决策的时候,要调动大脑全部神经,但大脑没有一个特定区域控制意识。只有在所有神经都激活,信息进行融合的情况下,才能给予意识控制权(give right to the consciousness)。这就提供了神经关联性或者意识的神经物证。

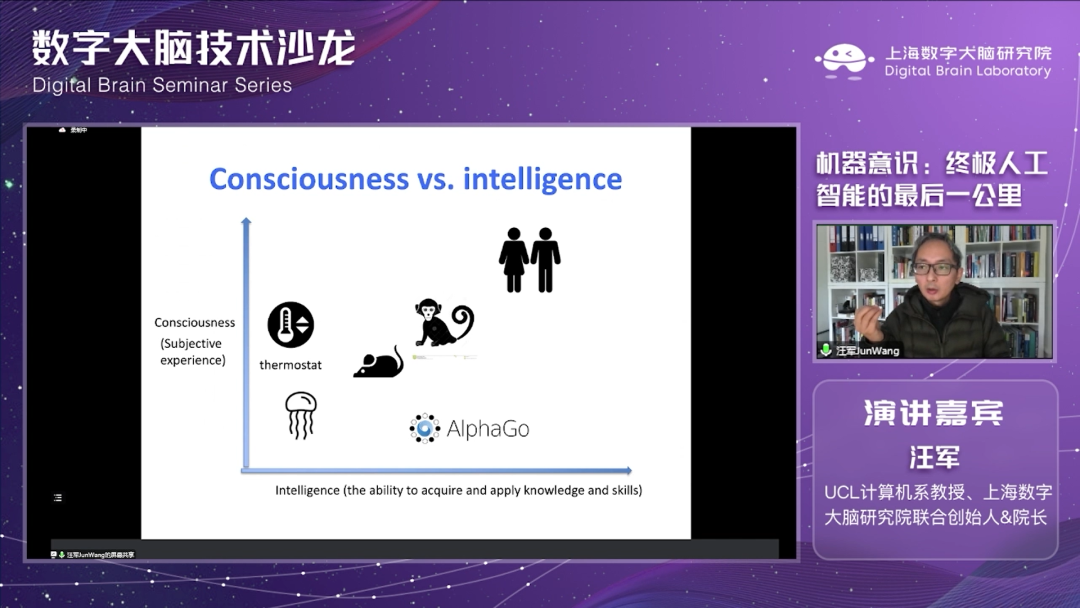

那意识的科学定义是什么?有一个不一定严谨但大家普遍接受的定义,即意识要有主观感受,感觉到同时能描述给其他人。意识和智能与决策是什么关系呢?它们不是同一个事情。意识是主观的感受和经验,智能是有能力去获得和应用知识与技能。智能可以适应环境,随环境变化,解决新问题,具有适应性。那适应性和意识的关系是什么?其实是进化,简单举例就是人类物种的进化才使我们能够存活。所以对环境的适应性最后为什么是给予意识控制权?意识必然和智能之间有关系,主观的感受或当智能达到一定阶段,意识也将成正比关系。因此智能在发展的过程中,意识可能需要存在。

说完意识和智能的关系,现在有一个微妙的问题,就是自由意志(free will)。有人说怎么知道意识是产生智能的原因?怎么知道意识跟人的决策有关系?或者怎么知道人可以完全通过意识的主观能动性进行决策?人当然可以根据我们的喜好自主决策。但回过头想想,作为生物体,人类也是由分子和原子构成的,遵循一些物理规律。那怎么会突然让自由意志产生呢?这里存在一个很大的随机性,这个随机性是受某一个特定的定义单元控制的。那这个机制是什么呢?

在80年代的一个实验让大家很惊讶,引起很多讨论。实验是让人去按键,当觉得自己想按键的时候就按键,同时通过一个表来记录,将这个过程的主观感受告诉给其他人在零点几秒的时候,在指针指到什么位置的时候,我感觉应该去按键了,然后你再按键。通过实验可以看到实际行动和主观要行动,意识发出报告是在此之前的,然后才产生了行动。在这个主观能动性里,要去做行动时,它是不是真正做行动的原因,还是说其实在之前大脑里已经在不知不觉中决定去行动,只是这个潜意识根源(intent ticket)报告说要去按。对于这个的解释众说纷纭。如果前面的信号一开始决定去行动,后面只是报告意识,那么这个意识对决策不起作用,也就是说所有现在的行为决策已经被大脑系统决定了。所以自由意志它是不是一个幻想,就取决于怎么解释这些信号。对于这个的解释有两种声音,一种是我们都是物理系统(physical system)控制的,身体缺什么,所以就喜好什么。另外一种则是,我们是有智慧和目的的,有智能可以进行决策。我个人的观点是决定论,即物理系统。但它漏了一个点,人作为一个载体,虽然整个物理的东西用它搭建,但作为整体是功能的模块。就像一个自动驾驶车,它虽然都是物质化的,但是在整车层面上,是有决策能力的。是什么样的原因当把它看成整体时候,便不能分割?它其实可能给予意识控制权。因此意识就有能力去做决定,可以智能地对环境作出回应,是有自由意志的。所以这和本质上的自然物理过程之间是不矛盾的。

下面再讲一下现有的意识,它是主观感受。我们怎么去理解它,它怎么产生的,怎样要给它建模型?一个理论叫全局工作空间理论(global workspace / global neural workspace)。它认为意识产生是整个大脑范围内的信息交换,去做决策的运动系统。它有一个全局工作空间,在这个空间进行信息交换,各个信息都传到全局工作空间,同时全局可以播送到周围其他地方。当进行播送后,其实也是所谓的信息整合。

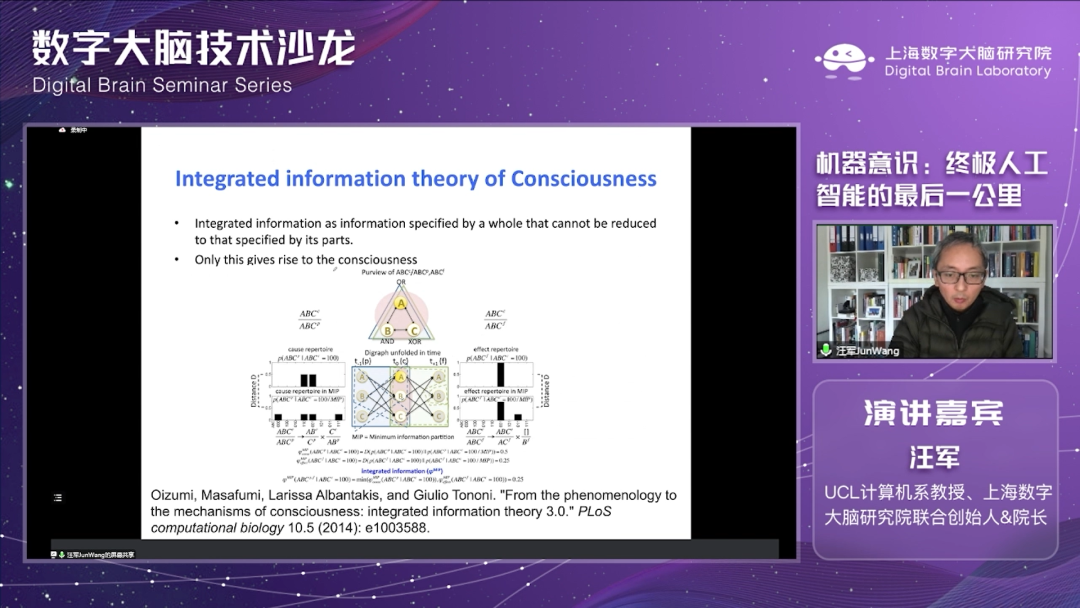

我刚才讲到一个困境是什么呢?人到底有没有能力去做自由的自主的决策。那么这种牵扯到信息交换层次的问题,意识经验是系统对信息整合,即整合信息一、信息二、信息三,可以获得大于其简单加总的信息。整合起来的信息,不可能进一步减少到个体信息。所以在信息集成的角度来看,信息集成后会给予意识控制权。因为大脑信息集成后不可能被进一步减少。在这层面上,作为一个逻辑单元,我们判断它是不是可以有主观意识。

所以在这情况下,信息整合理论(information integrate theory)通过一套数学手段,根据现象学哲学,做出假设,根据假设推出系统运作。它把动态系统在内部进行信息交换,交换到信息集成后,给予意识控制权。它和全局工作空间理论是相辅相成的。全局工作空间理论的架构,信息可进来,同时信息要回归到周围去,但没有考虑到信息怎样聚合。信息整合理论告诉我们,必须要有方法进行整合。在信息不可以进一步减少的情况下,才会给予意识控制权。那么我们用这套理论来去看现在的神经网络,就会非常失望。我们刚才讲的神经网络它本质上是前馈网络(feed forward),没有返回循环。在这个情况下,要测量它的信息整合度是零,没法把信息整合起来。但当信息是有反馈机制的时候,它的适应性是非常强的,测量它的整合信息,就会有一定的信息整合。所以这会提供对我们深度学习一定的指导意义。所以,我们必须要让深度学习网络不是前馈网络,必须要用循环结构进行信息整合。

所谓自我意识(self awareness),在镜像实验(Mirror test)种,一岁前的孩子看镜子里自己的形象,他不知道是自己,等岁数大了慢慢才知道。这个叫身体自我(bodily self),身体指是否知道他自己,对自己有没有认知。所以意识有一个比较重要的部分,是对自己的认知。这是元认知(meta recognition)的问题。所以自主意识(self conscious)机制是怎么产生的,我们为什么要有自主意识,它里面的机制是什么?现在的研究有一些在探索,有一个观点说它是分层次的,当人比较小的时候,分不清楚自己和环境的差别;但慢慢会知道一些身体活动,可能不构成系统。慢慢地,可以从镜子里识别出自己,到最后甚至可以感知他人,甚至可以拥有一个非常强的自我心理表征。所以机器和人都是一个逐渐认知的过程。那么其中,我觉得现阶段机器学习很有意思的方向,是身体自我的问题。我们讲具身人工智能(embodied AI),其实对身体自我没有好的认知,我觉得这个方面的很多工作其实非常有意思。其次是元认知,怎么去对分析的东西从元层次上审视,我们现有的meta是基于任务的跨任务方案,但为什么没有一个对我们自己学习过程的meta,或者审视我们学习过程的meta,这些话题都是值得探讨。

3

机器意识与当今进展

我大概把关于意识的几个点都讲了,包括自由意识,自主意识,你自己是什么,它的机制是什么,包括一些理论。那么从计算机科学角度去看这个问题,那显然我们学习的对象是机器。我们希望机器通过现在的深度学习,或者其他学习方式能够给予意识控制权,然后进入系统控制,有更强的智能。在这过程中,它不是一蹴而就,而是循序渐进的过程。

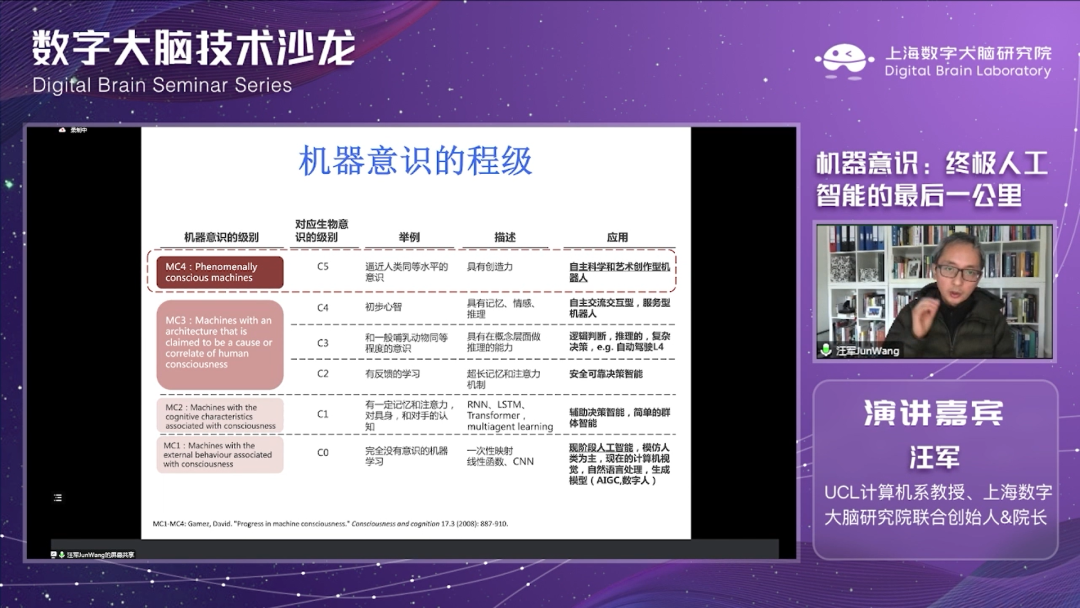

就像自动驾驶,我们也进行了分级。这是第一次给机器意识进行分级,从的功能和应用角度来分,进行了01到05的分级。现在大部分研究都聚焦在C1和C0。首先是模仿,监督学习,把人的决策行为和判断告诉X和Y进行映射,这是我们现在所有的人工智能,所有任何深度学习做的模式识别,都属于C0。C1要理解认知过程,基于各个类进行相应建模,然后再做信息的交换,多智体的交流,建造一个对手模型,做一些群体智能的事情。所以聚焦在记忆力、注意力,对自身和对手的了解,是C1阶段。

刚才讲的反馈学习,如果能把一个反向传播(backprop)解决信息从自下而上同时自上而下都可以,那我们就可以更安全可靠地决策,然后逻辑判断能力就会有L4这种自动驾驶,甚至有心智。在有一点心智的情况下,我们和机器的交流可能完全不一样,我们会产生服务机器人,到最后甚至是自主的具有科学创作和艺术创作能力的机器人。C5的艺术创作和C0现在我们看到的AIGC本质不同,现在的AIGC还是在模仿人,模仿得很像,但C5是逼近人类同等水平的意识,且不排除超过的可能性,但超过以后它是什么样,我不知道。所以我觉得现在这样可能比较可以实现的,C5的目标很好,至于以后是什么,要额外进行思考。

怎么做去达到这个目标?计算机科学家和AI的人都非常关注机器意识,比如说这篇文章是在深度学习上做了一些很小的改动,把所谓的意识全局工作空间理论概念改成深度学习网络,在第一阶段进行各个模块化去神经网络的学习。然后全局的共享空间把它整合起,整合完再发送到各个地方,它的目的是让各个模块之间融合。通过这个方式产生一个新的神经网络的结构解决适应性的问题。

那么如果讲决策,我们做决策的时候,当设计强化学习的代理时,现在的mdp肯定是不够的。我们需要模型基础,建立视觉模型,对环境了解,对对手建模,理解设计,所谓的内部奖励(intrinsic reward),我们还要参考和进行元认知。那么这些模拟怎么搞都是非常有意思的话题,里面有研究倾向可以值得去研究理解,做了其中之一就会产生各种不一样的应用。我刚才也讲了,从C0到C5里,只要做出一点点,对行业的影响都是巨大的。

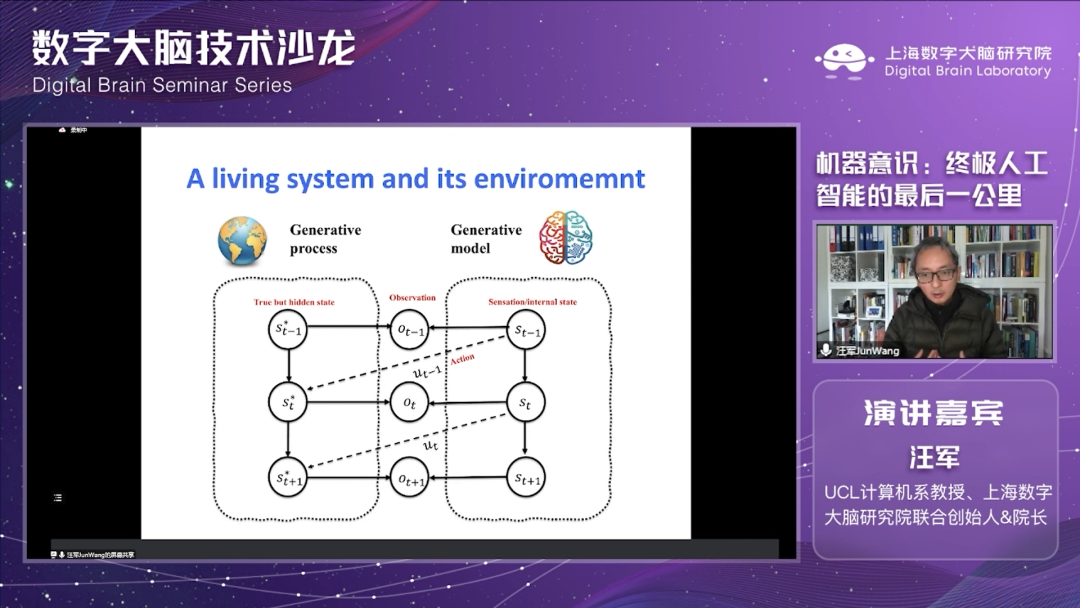

其中有个观点,从另一个维度去考虑生物体的时候,使内部的所有的状态尽可能少地变化。这就是主动推断(Active inference)的概念,就是内部状态在外界环境变化的情况下不能有太大变化,比如我们内部的体温和体液等等。所以需要整个身体功能保持在一定状态的稳定。然后再探究外部的环境,如用技术让我们可以到水下,南北极,火星月球。AI系统就是为了在外界环境无论怎么变化,都能帮助我们保持内部状态。所以这是AI终极扮演的一个角色。在我们刚才讲的这个目的里,同样的道理,我们对AI建模时,就需要用作为推理的控制的方法,或者尽量减少熵值,即随机性,通过这种方式去建模,会发现非常有意义的事情。

其次,心智理论(theroy of mind),就像C0C1,C1需要对对手建模,此前需要对自己建模。这个地方有一个所谓的心智理论,也是在神经科学里,就是我要对别人建模,别人可能要对我建模。那我怎么样能够收敛?我们可以用一些概率的方法解决。

还有version model,我们大脑里面其实在转,信息在流淌,为什么?它是在思考。所以最后要形成机器可以思考的时候,必然要对环境建模,对对手建模,同时要有因果关系。所谓因果关系,只有成本效益关系建立起来以后才可以实现。所以我们对世界建模,然后对建模里考虑它的混合因素是有一些外因变量的关系,怎么去建模外因变量,通过它我们可以不光只是建视觉模型,在任何有变化的视觉模型情况下,我们都可以去处理问题。

总结下今天的报告,我希望这是个抛砖引玉的分享,机器学习是持续不断的工作,我抛出的问题比我的答案更多。我主要讲了几个点:现在深度学习的问题什么?怎么去解决它?解决它的答案可能要从人的大脑机制去理解。那怎么样理解意识及相关概念?我们的自由意识是不是跟我的最终决策有关?那么我们是不是有自我的概念?我们怎么样去对它建模?机器AI和意识之间是不是可以联合做成机器意识?

Q&A环节

Q:请问汪老师如何理解AI的主观与客观。

A:汪老师理解这个问题的意思是在问AI的主观能动性,他认为目前的AI的没有主观能动性,现在都只是客观的,在AI觉醒产生意识之前,其实都不太有可能有真正意义上主观的 AI 。

Q:神经网络还可以认为是一个函数,这个观点您认同吗?

A:对的,比较狭义的理解,神经网络就是一个函数,从X映射到Y。

Q:机器意识是不是通过函数建模的?

A:这个问题他也在思考,到底该是一个什么样的形式,什么的函数。从大的方向上讲,从人的大脑来讲,最终也是一个映射,从一个X到Y,从已知到未知。这个映射可能是函数关系,也可能有其他更复杂的映射关系。这个函数是怎么样的,目前汪老师的感觉是这个函数必须有反馈机制,具备局部到整体再到局部的能力。

Q:人的意识是不是也是一个概率问题,任何一个选择都有可能发生,只是概率不大相同?

A:这位同学的观点其实还是决定论,这个决定可能是一个given的分布。但是所谓自由意识,是说你能够在一定的情况下,进行判断与思考,然后能够决定,这可能是一个不可知的,或者说只和个体有关系,是一个很微妙的关系。目前汪老师对于这部分也不是100%想通,但是他个人觉得,如果概率至少不会随着时间变化,那他肯定还是属于决定论的范畴。

Q:目前的计算机结构有可能实现通用人工智能吗?

A:这是一个好问题,关于通用人工智能,汪老师是持比较积极的态度,同时他表示,可能目前的计算机结构智能达成一定级别的机器意识水平,但是不可能是完全没有。